目錄

- 一、 Accuracy 臨床 AI 的多元應用

- 二、 User Privacy 隱私保護

- 三、 Reliability 從準確到可靠

- 四、 Cross-site 跨場域 x 一致性表現

- 五、 Component-wise 強化小組件

- 六、 User Trust 提升使用者信心

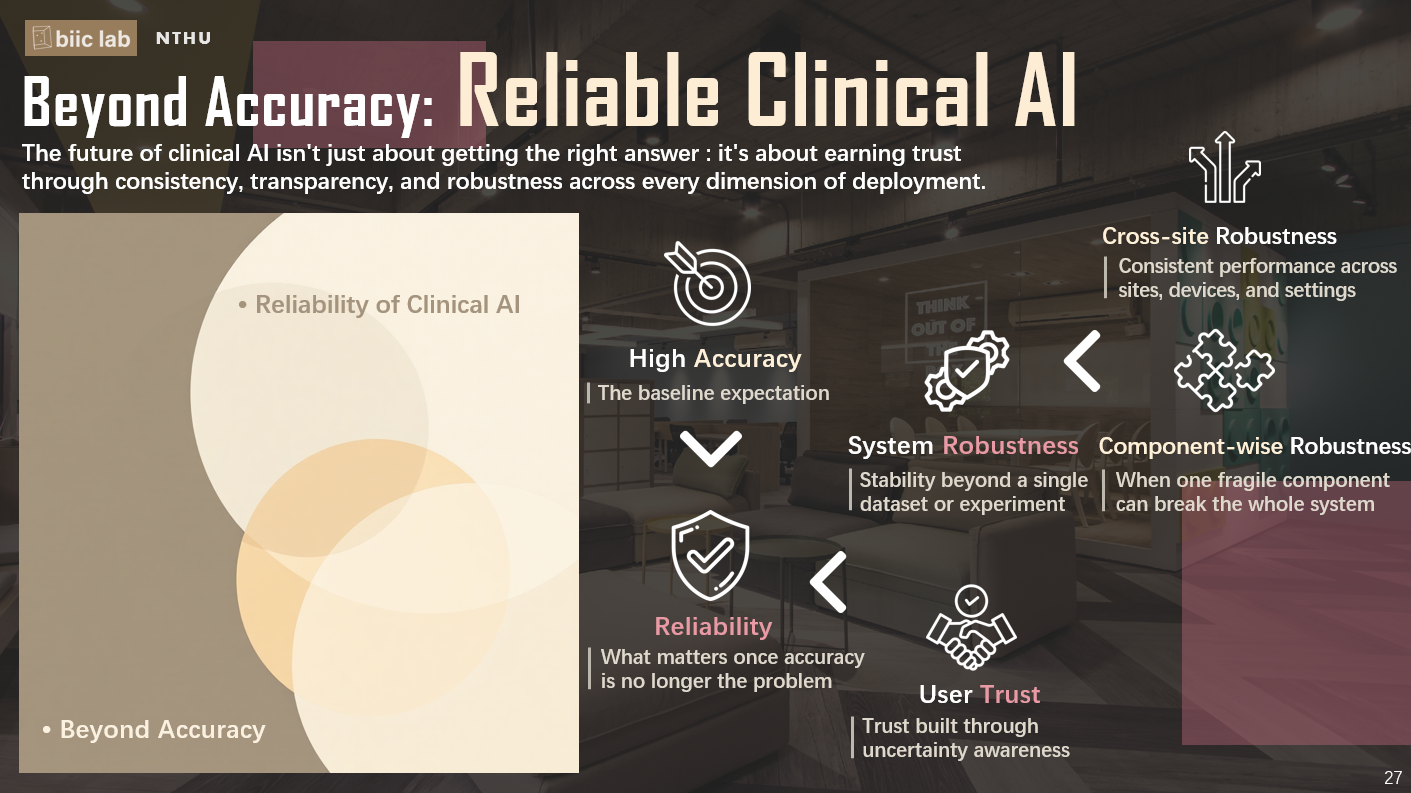

- 七、 Reliable Clinical AI 總結

近期,李祈均老師受邀至新加坡科技研究局 A*STAR(Agency for Science, Technology and Research)進行專題演講。今天,我們將首度揭密這場演講的核心內容,帶你探討當 AI 模型已經做到很準確時,下一個臨床 AI 的真正戰場在哪裡?

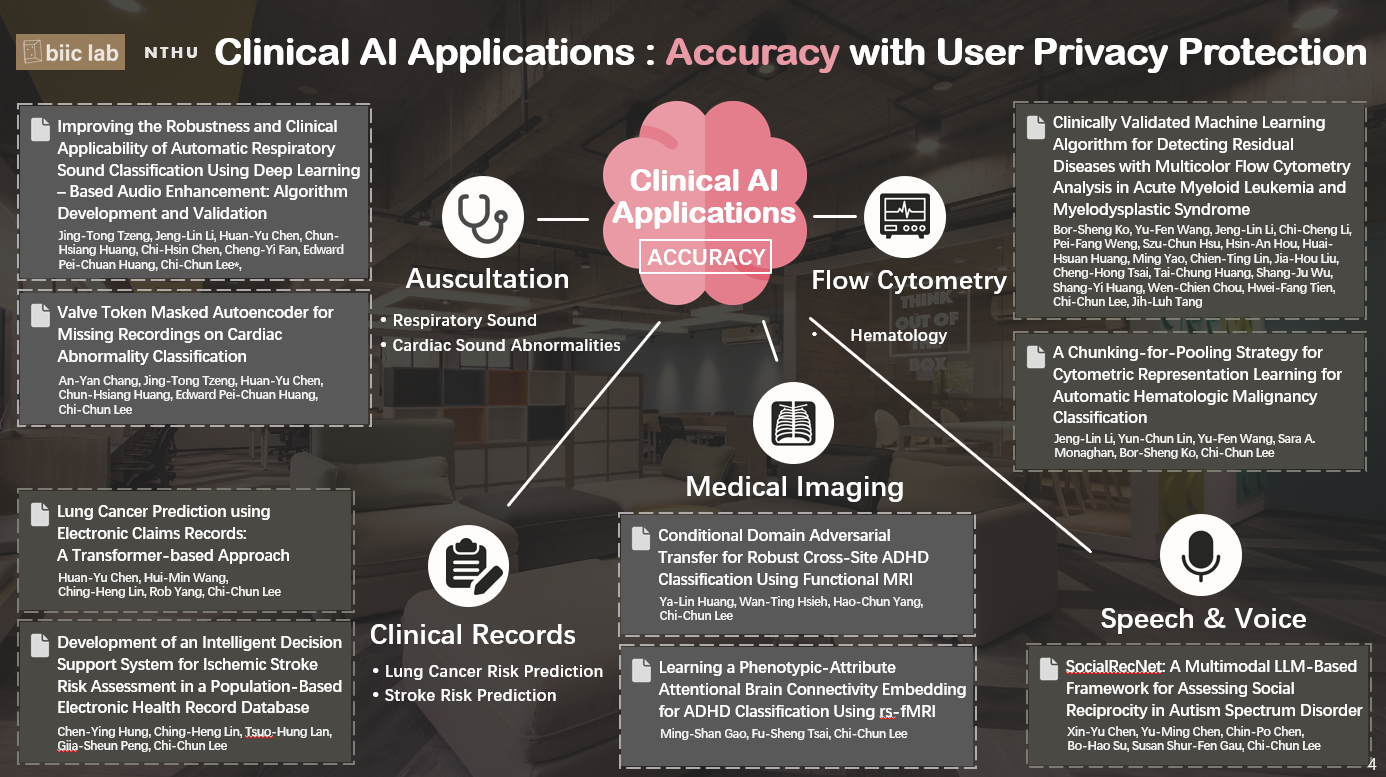

一、 臨床 AI 的多元應用與準確性表現 — Accuracy

臨床 AI 的應用其實比想像中還要多,也出現在各種不同型態的醫療資料與臨床情境之中。一路發展到現在,臨床 AI 技術已經相當成熟,不論是在提升診斷準確度(Accuracy),或是在保護使用者隱私(User Privacy Protection)方面。在準確度(Accuracy)提升上,我們實驗室過去有做過這五種應用的研究:

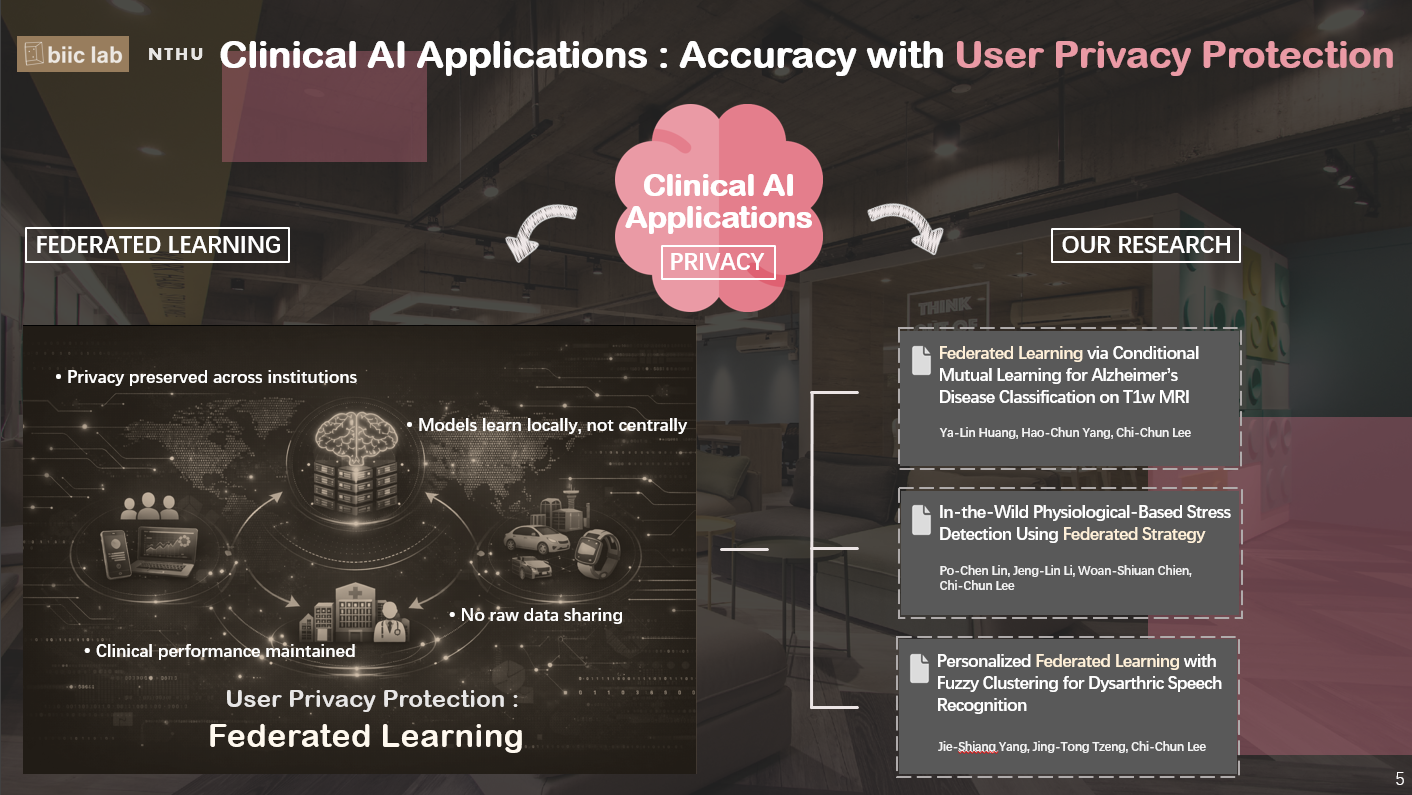

二、 臨床 AI 的多元應用與使用者隱私保護 — User Privacy Protection

當臨床 AI 的應用越來越多時,另一個重要的問題也跟著出現:如何在使用醫療資料的同時,保護使用者的隱私,不讓使用者的個人資料被濫用或外洩。也就是說,除了模型本身表現好不好,使用者隱私保護(User Privacy Protection)也很重要。在研究使用者隱私保護(User Privacy Protection)時,我們實驗室主要用了聯邦式學習(Federated Learning)這個方法。簡單來說,聯邦式學習讓模型直接到各個資料的地方學習規律,而不用把資料集中起來。這樣一來,模型可以抓到資料的特徵,但個人資料不會被搬走或分享,自然就保護了隱私。我們實驗室就是透過聯邦式學習(Federated Learning),來研究在不同臨床情境下,如何兼顧模型表現和使用者隱私,相關研究可以參考下面這三篇論文:

"Federated Learning via Conditional Mutual Learning for Alzheimer’s Disease Classification"

"In-the-Wild Physiological-based Stress Detection Using Federated Strategy"

"Personalized Federated Learning with Fuzzy Clustering for Dysarthric Speech Recognition"

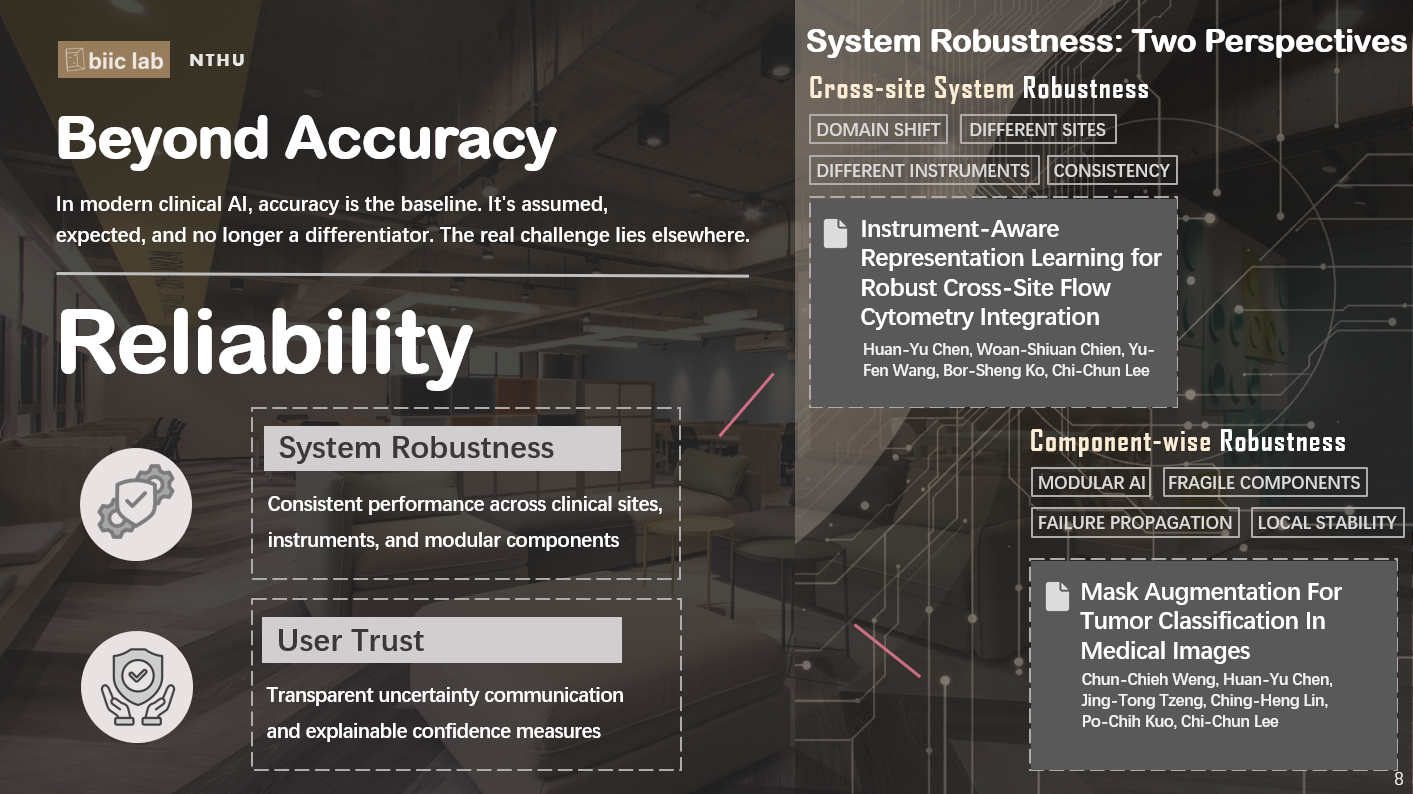

三、 從準確到可靠:系統穩定度與使用者信任 — Reliability

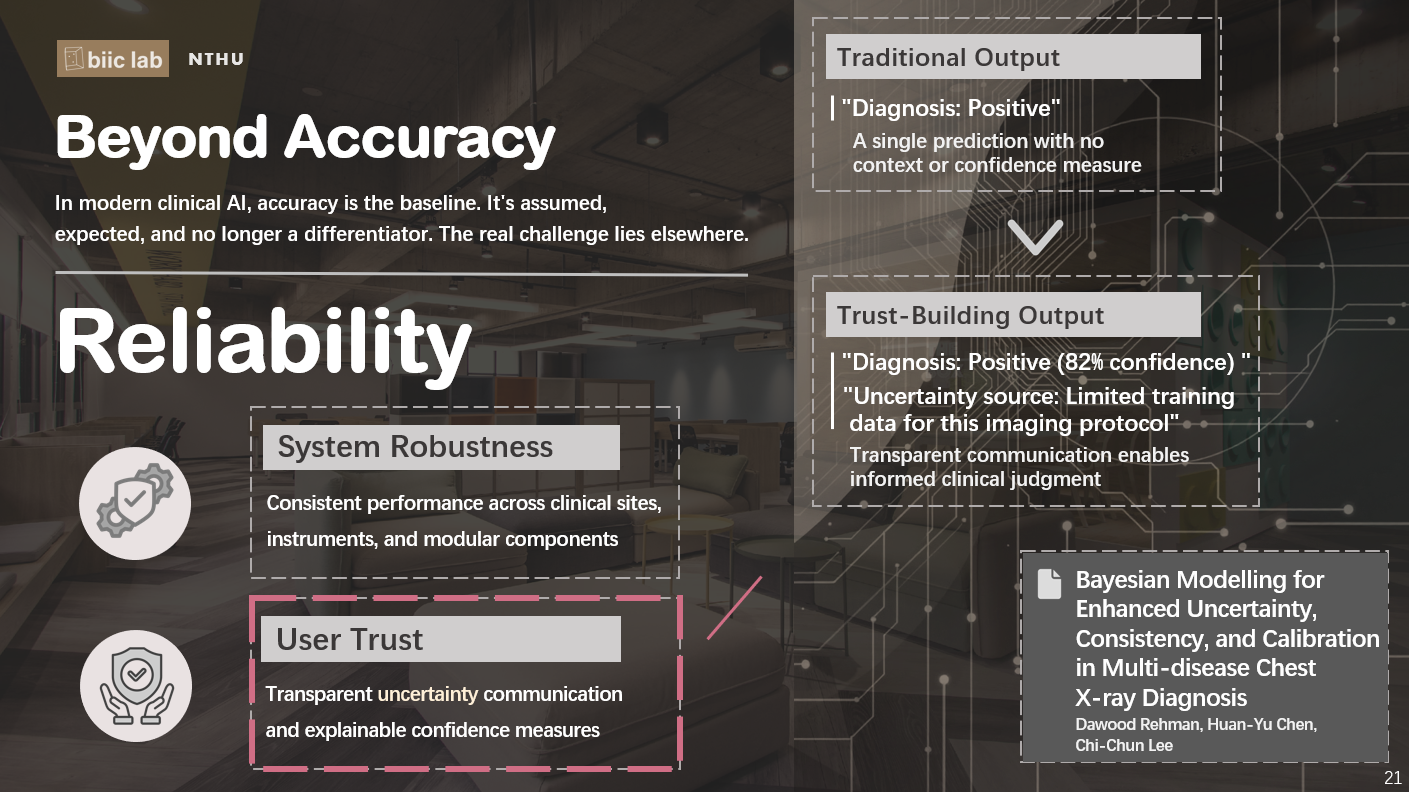

在模型已經很準確、隱私也被好好保護之後,真正的挑戰才剛開始,那就是「可靠性」(Reliability)。李祈均老師在演講中提到,AI 的可靠性其實可以從兩個面向來理解:一個是「系統強健性」(System Robustness),另一個是「使用者信任」(User Trust)。「系統強健性」(System Robustness)是在說系統在不同醫院、不同設備、甚至不同資料條件下,能不能維持一致而且穩定的表現,確保整個運作流程不會因為一點改變就出問題。「使用者信任」(User Trust)指的是 AI 不只給一個是或不是的結果,而是讓使用者知道更多判斷背後的資訊,讓使用者更能理解模型的判斷,也更能相信它的結果。

四、 克服差異:實現穩定的跨院診斷 — Cross-site Robustness

在醫療 AI 的實際應用中,很常會遇到一個問題:同一套模型,放在不同醫院、不同臨床環境下,表現卻不一定一樣。不同的設備型號、量測方式,甚至各院的操作流程,都可能讓模型接收到的資料長得不一樣。對 AI 來說,這些看似細微的差異,很容易影響判斷結果。跨場域系統強健性(Cross-site System Robustness),講的就是模型能不能在這些不同情境下,依然維持一致、穩定的表現,而不是只在特定場域特別準。針對這個問題,我們實驗室研究出「Instrument-Aware」的學習方法,讓模型在訓練過程中分辨哪些特徵真的和疾病有關,哪些只是來自不同儀器或設備造成的差異,使系統在不同醫療機構之間切換時,仍能保持穩定的表現。

|相關論文連結:

Instrument-Aware Representation Learning for Robust Cross-Site Flow Cytometry Integration

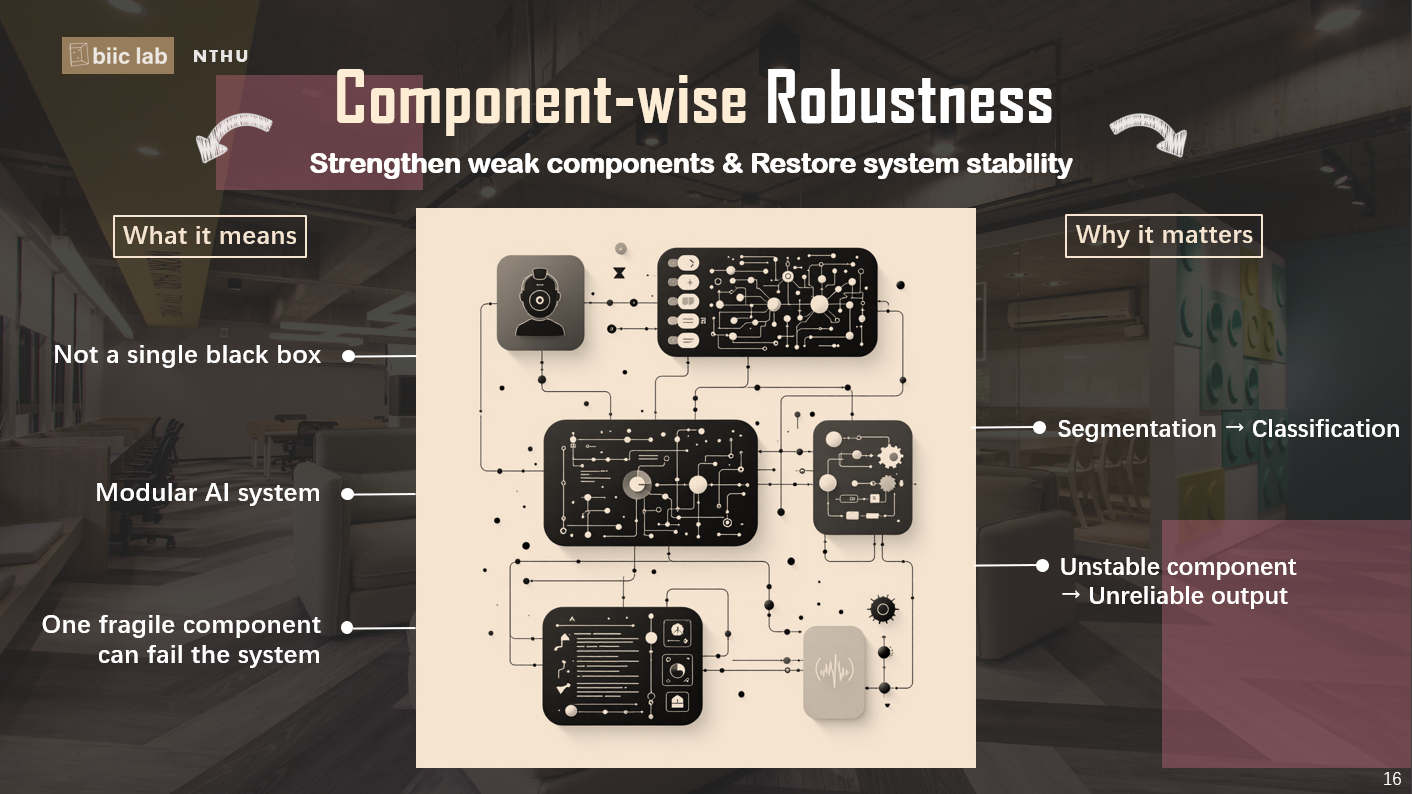

五、 強化小組件:提升整體系統的穩定性 — Component-wise Robustness

一個臨床 AI 系統其實不是單一模型在運作,而是由很多「小組件」串起來完成判斷。像是前面先做影像分割,接著再進行分類,只要其中一個環節不穩定,後面的結果就很容易跟著失準。這也是為什麼 Component-wise Robustness 很重要!在這部分,我們實驗室的做法是直接針對容易出問題的環節下手,透過像是 Mask Augmentation 的技術,讓模型在訓練時就先遇過資訊不完整或影像受損的狀況,學會怎麼應對。當每個小組件都更穩定,整個 AI 系統在實際臨床使用時,表現自然也就更可靠。

|相關論文連結:

Mask Augmentation For Tumor Classification In Medical Images

六、 讓 AI 更透明:從答案導向轉向信心度評估 — User Trust

現在,我們正在推動一場從「答案導向」到「信心導向」的轉型。意思是,AI 不只告訴你「是或不是」,而是會說清楚它有多確定。這是我們實驗室正在進行的研究方向之一,透過貝式建模(Bayesian modelling),讓 AI 在給出診斷結果的同時,也能標註它的信心程度。例如,AI 會告訴醫師:「我覺得有 85% 的機率是肺炎,但因為這張影像有點模糊,我的不確定性來自於雜訊干擾。」有了這種透明的信心資訊,醫師就能更安心地判斷,哪些結果可以參考、哪些需要再多看一眼。

|相關論文連結:

Bayesian modelling for enhanced uncertainty, consistency, and calibration

七、 總結:邁向真正可落地、可靠的臨床 AI 系統 — Reliable Clinical AI

這場在新加坡 A*STAR 的演講中,李祈均老師為我們描繪了臨床 AI 的未來藍圖。當準確度(Accuracy)已經成為基本功,真正的技術壁壘將建立在系統的可靠性(Reliability)之上。從環境適應力(Cross-site Robustness)、環節穩定度(Component-wise Robustness)到醫師的信任建立(User Trust),這些都是臨床 AI 能否從實驗室走進診間、真正造福病患的關鍵指標。我們也期待透過持續的研發,讓 AI 成為醫療前線最堅實、最可靠的後盾。